ChatGPT a-t-il accouché d’une souris ?

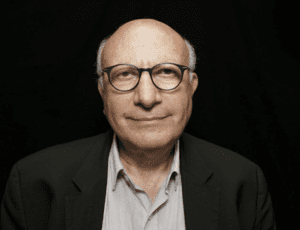

Entretien avec Jean-Gabriel Ganascia

⏱ 5 minLe 30 novembre 2022, OpenAI lançait ChatGPT. Cinq jours plus tard, il avait déjà un million d’utilisateurs ! Jugé tout à tour fascinant, brillant, insipide, stupide, dérangeant, effrayant… il n’a pas laissé indifférent. D’aucuns ont voulu donner un coup de frein aux recherches sur cette technologie, l’interdire, réglementer son usage. Mais six mois après son arrivée spectaculaire, la Terre tourne encore. ChatGPT est toujours là, rejoint par ses premiers comparses (Google Bard, Bing Chat de Microsoft…). Avec le recul, que faut-il en penser, en faire ou ne pas faire ? Entretien avec Jean-Gabriel Ganascia, professeur et chercheur en intelligence artificielle à Sorbonne Université, ex-président du comité d’éthique du CNRS.

Data Analytics Post : De quoi ChatGPT est-il le nom ?

Jean-Gabriel Ganascia : ChatGPT sait parler comme un perroquet. Il enchaîne les mots, mais il ne s’intéresse pas à leur sens. Il ne comprend pas ce qu’il dit. Le mécanisme initial sur lequel est bâti ChatGPT est la prédiction du mot le plus probable après… d’autres mots. C’est-à-dire en fait le mot le plus fréquemment rencontré, dans un contexte similaire, lors de son entraînement sur de très nombreux textes, l’équivalent en volume de centaines de milliers de livres. Sa syntaxe est convenable, mais son propos est plat, il enchaîne les lieux communs. ChatGPT n’est pas rationnel : il ne raisonne pas, ne vérifie rien. Il n’a pas de sens commun. Parfois, il ment comme un arracheur de dents. Pourtant, il faut l’admettre… le résultat est assez impressionnant.

ChatGPT dit beaucoup de bêtises, mais il semble bien élevé…

OpenAI a pris des précautions. Avant d’être mis en accès libre, son modèle de langage a été en quelque sorte “aseptisé”, en faisant appel à l’apprentissage par renforcement. Des humains ont réagi à ses réponses, afin que ChatGPT apprenne à éviter les dérapages. On l’a ainsi “éduqué” pour qu’il s’abstienne de tenir des propos jugés inconvenants selon divers critères. Il ne profère pas de grossièretés, ne tient pas de discours sexiste, ni raciste…

ChatGPT a donc une certaine, comment dire, “sensibilité”, fixée par son créateur ?

En quelque sorte. D’ailleurs, certains commentateurs le critiquent en le qualifiant de “woke”… On peut imaginer qu’un autre acteur propose un jour un perroquet plutôt conservateur.

ChatGPT et ses semblables pourraient être utiles à qui, et pour quel usage ?

Un avocat, un journaliste, un étudiant… peut être tenté de l’utiliser pour produire sans effort des textes insipides. Mais en faisant cela, il prend des risques. S’il ne veut pas avoir de mauvaises surprises, il devra les relire soigneusement et vérifier la véracité de ce qu’ils affirment. ChatGPT est parfaitement capable de proférer des absurdités, de gloser sur les qualités des oreillers en plumes de stylo ou sur les mérites respectifs des œufs de poule et de cheval. À son insu, ChatGPT manie bien le nonsense, ce qui pourrait en faire un outil intéressant pour les humoristes.

Cette technologie va révolutionner le moteur de recherche ?

Conséquence de la séduction qu’il exerce, certains l’utilisent déjà comme oracle. On entend de plus en plus souvent dire : « J’ai demandé à ChatGPT, et il m’a répondu que… » Beaucoup s’informent auprès de lui, en particulier sur des questions de santé. Il y a un véritable risque que certaines personnes utilisent les futurs moteurs de recherche dopés à l’IA générative pour demander : « Dr Google, qu’est-ce que vous me recommandez pour ma tension… ? » Ils pourraient obtenir des réponses absurdes, comme la suggestion de Donald Trump d’absorber de l’eau de Javel pour lutter contre le virus du Covid…

Que faire pour limiter les dégâts ? Faut-il règlementer, interdire ?

Une lettre ouverte préconisant un moratoire sur ce type de recherches a été publiée. Pourtant, ce n’est pas en cessant de travailler que l’on corrigera les défauts de cette technologie, ni que l’on se prémunira contre les risques associés. ChatGPT a été interdit en Italie : c’est un peu absurde. Cette technologie va s’immiscer dans toutes sortes d’outils. Comment distinguera-t-on les usages acceptables de ceux qui ne le sont pas ? De même, dans le “AI Act” que prépare l’Union européenne pour réglementer l’intelligence artificielle, on propose d’interdire les systèmes dits à « haut risque » et, parmi eux, les IA génératives, pour les groupes vulnérables ou dans les situations de vulnérabilité. Mais, comment définir clairement cette catégorie sans adopter une attitude paternaliste ? Qui plus est, un arrêt des recherches est improbable. Et je n’imagine pas une seconde que l’on puisse tout à coup décider de ne pas utiliser cette technologie. Il sera sans doute utile de fixer des règles, mais ce ne sera pas facile.

Faut-il simplement compter sur l’éducation du public ?

Est-ce qu’il est vraiment dupe ? Le public est plutôt prêt, il se méfie. Si ChatGPT dit des bêtises, après tout ce n’est qu’un générateur de fake news de plus… Chacun apprend en grandissant à « faire avec » la bêtise humaine, et s’adaptera à la bêtise artificielle.

À long terme, quel risque nous fait courir cette technologie ?

À terme, ChatGPT pourrait modifier notre manière de rédiger : on lancera quelques mots clés… et l’outil proposera un texte, sans saveur ni garanties, mais qui tiendra compte plus ou moins habilement du contexte, de ce qu’on dit dans cette situation… Et si le premier jet ne convient pas, il suffira sans doute de désigner le passage problématique, de cliquer sur des options, au pire de l’éditer soi-même. Aspect positif : ce sera la fin de l’angoisse de la page blanche…Ce qu’il faut craindre, c’est notre propre paresse. Un outil qui rédigera à notre place risque de nous rendre dépendant en sorte qu’un jour il se peut qu’on ne soit plus capable d’écrire sans lui. Le bon côté, c’est que cela réglerait le problème de l’orthographe ! Il se pourrait aussi qu’en s’appuyant sur les technologies de profilage, les Google et consorts cernent nos points sensibles et produisent des textes susceptibles de nous faire réagir pour accroître les flux d’information — et par là leurs bénéfices — que ces textes correspondent à ce que nous pensons ou qu’ils nous exaspèrent au point de provoquer notre réprobation active…

Certains ont crié au miracle : ChatGPT serait un pas vers ce graal de l’IA, l’intelligence artificielle “générale”…

Attention : ne pas confondre IA générative et IA générale ! Depuis 45 ans, on sait très bien que l’intelligence n’est que la résultante d’un ensemble de capacités cognitives (perception, mémoire, raisonnement, apprentissage, etc.). L’idée même “d’intelligence générale” n’est pas scientifique. Elle est même condamnable d’un point de vue scientifique. Elle repose sur l’hypothèse d’un ingrédient en quelque sorte magique, qu’il resterait à découvrir et à maîtriser. ChatGPT est doté d’une aptitude particulière : il sait générer du texte. C’est étonnant, mais c’est peu de chose… Ah, c’est vrai, il a aussi le sens de l’humour. Mais il ne le sait pas…

Pour conclure : est-ce que ChatGPT est une surprise ?

Du point de vue de la science, ce que l’on réussit à faire avec les grands modèles de langage est surprenant. Qu’un simple traitement statistique lourd d’une masse de données permette d’obtenir ces résultats, mieux que tout ce que l’on a tenté auparavant, c’est une surprise. C’est contre-intuitif, c’est à l’opposé de ce que l’on pensait depuis 30 ans. On a longtemps estimé qu’il fallait absolument introduire des connaissances, et puis… Mais cette surprise, d’une certaine façon, n’en est pas vraiment une : en IA, ce n’est jamais ce que l’on avait imaginé qui marche.

Propos recueillis par Pierre Vandeginste

Image en une : © Laurence Honnorat