IA de confiance : la HAS montre la voie avec sa grille d’évaluation des dispositifs médicaux

⏱ 4 minLa grille d’évaluation des dispositifs médicaux intégrant de l’IA, mise en place il y a un an par la Haute Autorité de santé pour octroyer ou non le remboursement par l’assurance maladie, défriche l’épineux problème de l’IA “de confiance”. Un effort précurseur, qui inspire d’autres agences de santé, institutions et organismes d’homologation.

« Déjà en 2017, nous recevions de plus en plus de demandes concernant des dispositifs médicaux connectés et nous pouvions entrevoir l’arrivée de dispositifs intégrant de l’intelligence artificielle (IA) », raconte Isabelle Adenot, présidente de la CNEDiMTS (Commission nationale d’évaluation des dispositifs médicaux et des technologies de santé). Cette commission de la Haute Autorité de santé (HAS) est notamment chargée d’évaluer ces dispositifs quand leur fabricant sollicite un remboursement par l’assurance maladie. « Nous avons d’abord clarifié le paysage alors assez nébuleux, tant pour les patients, les professionnels que les ministères, se souvient-elle, on mélangeait les applications de bien-être avec des solutions destinées aux patients ou des outils pour les professionnels comme des aides au diagnostic. »

Rappelons quel parcours un industriel doit suivre pour que son dispositif soit remboursé par l’assurance maladie en France. Première étape : pour être mis sur le marché en Europe, un dispositif médical intégrant de l’IA, comme tout autre produit, doit obtenir un « marquage CE », sésame qu’il peut obtenir auprès de la vingtaine d’organismes notifiés européens (organismes indépendants évaluant la conformité au droit de l’UE) dont le GMED en France, filiale du Laboratoire National de Métrologie et d’Essais (LNE). Ensuite, si l’industriel sollicite ce remboursement, son dispositif est évalué du point de vue clinique en termes de service attendu puis du point de vue de la qualité de son IA par la CNEDiMTS.

Celle-ci donne un avis favorable ou non selon l’amélioration du service qu’apporte le dispositif par rapport à ce qui existe déjà en France, et selon la population ciblée, éléments qui serviront à définir ensuite le niveau du remboursement. « Notre évaluation n’est que déclarative, précise Isabelle Adenot. Notre but, sur la base des informations que nous fournit l’industriel, est de comprendre comment le système a été conçu et comment fonctionne son IA pour que le patient puisse être informé en toute transparence. »

UNE PREMIÈRE MONDIALE

Comment une institution si peu au fait de ces thématiques s’en est-elle emparée ? « En sollicitant des experts sur ce sujet particulièrement innovant, répond la présidente. Comme rien de tel n’existait dans le monde, nous avons lancé un appel à contribution publique. Près de 80 industriels, universitaires, patients, startups y ont participé, y compris le LNE. Notre grille d’évaluation, publiée en octobre 2020, est le fruit de ces deux ans de travaux. » C’est un dossier à remplir par l’industriel. Particulièrement bien conçu de l’avis de tous, il inspire depuis le LNE et d’autres organismes notifiés européens ainsi que de nombreuses agences de santé dont la Food and Drug Administration (FDA), qui autorise la mise sur le marché des dispositifs médicaux aux États-Unis et prépare son propre dossier d’analyse.

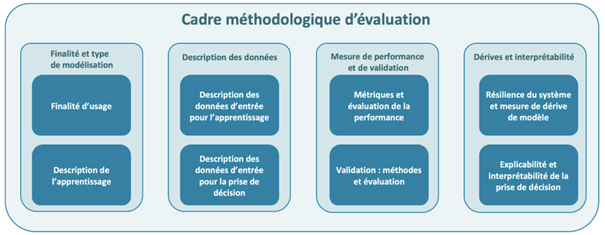

Qu’y a-t-il donc dans cette grille ? 42 items dans quatre domaines clés (voir ci-dessous) : la finalité d’usage du dispositif et le rôle de l’IA, les données d’entrée et de sortie, les performances du modèle (quelle tâche assure-t-il ? Comment a-t-il été conçu ? Comment sera-t-il ré-entraîné et par qui ?) et ses caractéristiques fonctionnelles, notamment sa robustesse, sa résilience ou son interprétabilité (comment est mesurée la performance ? Comment évolue le modèle si l’environnement change ou en situation critique comme un capteur défectueux ? Peut-on expliquer son fonctionnement ?). « Bien sûr, nous faisons aussi appel à des experts en IA si besoin », ajoute Isabelle Adenot.

© Quantmetry

« Quantmetry (cabinet de conseil spécialisé en IA, ndlr) a été un partenaire clé », reconnaît-elle. C’est notamment Guillaume Hochard, alors expert chez Quantmetry qui, avec d’autres, a posé les bases de cette grille et défini le vocabulaire commun. « Nous sommes également intervenus ensuite pour former les chefs de projet à l’interprétation de la grille », ajoute Gill Morisse, senior manager chez Quantmetry. Ce dernier souligne également que l’enjeu aujourd’hui réside dans la capacité de ces dispositifs à passer à l’échelle pour être utilisables par un million de patients et que la sécurité des données personnelles, si elles sont stockées dans le cloud, soit assurée.

BIENTÔT, DES LIGNES DIRECTRICES EUROPÉENNES

Contre toute attente, parmi les nombreux dispositifs médicaux mis sur le marché dans le monde, peu intègrent de l’IA. Et lorsque c’est le cas, ils sont surtout destinés aux professionnels de santé comme Cardiologs (pour l’analyse des électrocardiogrammes) ou Icobrain (pour le suivi de la sclérose en plaques, de traumatismes crâniens ou de démence à partir d’IRM et scanner).

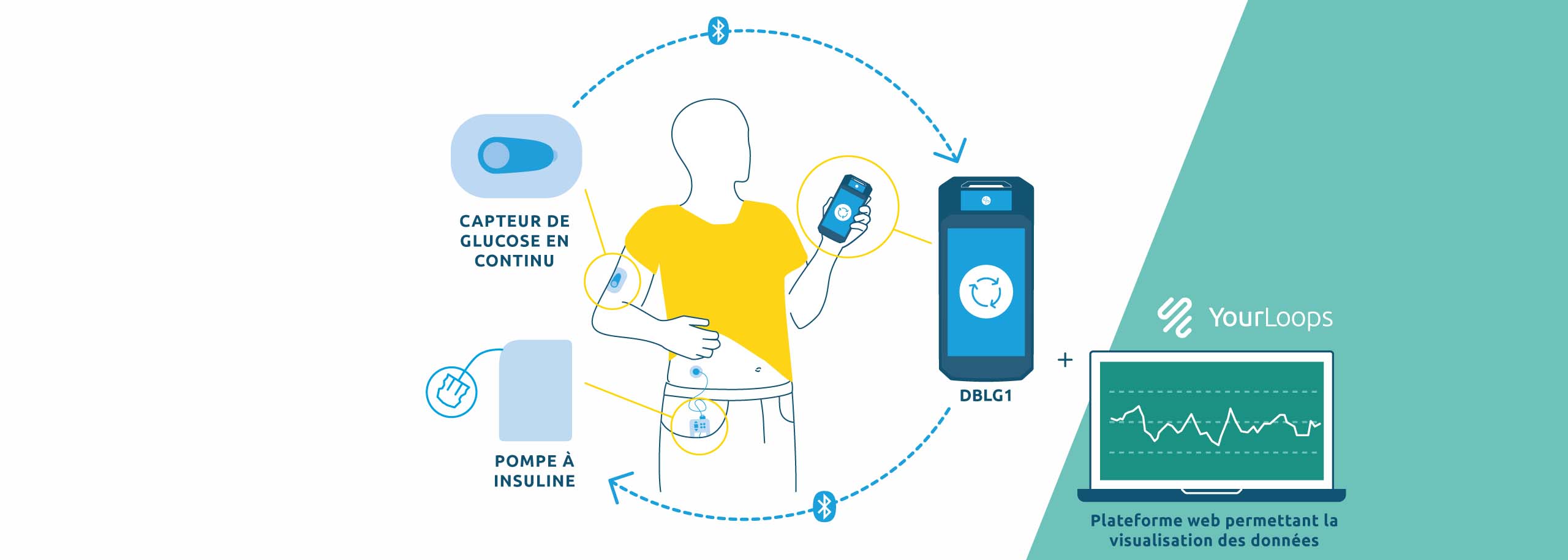

« Pour l’instant, nous n’avons pour mission d’évaluer que les dispositifs médicaux destinés aux patients, précise Isabelle Adenot. Deux dossiers nous ont été soumis, pour lesquels nous avons donné un avis favorable : celui de Diabeloop (délivrance d’insuline pour les diabétiques) et celui de Sunrise (diagnostic de l’apnée du sommeil) qui a sollicité une prise en charge via un forfait innovation spécifique aux technologies en phase précoce de développement clinique. Mais nul doute que face au déferlement de solutions pour les professionnels, en radiologie, imagerie, etc., nous contribuerons d’une manière ou d’une autre à des évaluations, par exemple à l’élaboration de référentiels. D’ores et déjà, nous préparons ceux sur les dispositifs de télésurveillance en insuffisance cardiaque, respiratoire ou rénale et pour le diabète, dont la prise en charge pérenne vient d’être votée. Certains intégreront assurément de l’IA dans le tri de leurs alertes. » Les règles vont par ailleurs changer d’ici quelques mois, lorsque sera publié le règlement européen sur l’IA, avec des contraintes imposées selon le niveau de risque.

Isabelle Bellin

Pour en savoir plus :