Que peut l’IA pour la cybersécurité ?

⏱ 4 minÉlectorats influencés, hôpitaux rançonnés… les menaces empruntant les voies du numérique se multiplient et se diversifient. La cybersécurité peut-elle compter sur l’IA pour concevoir de meilleures armures contre ces nuisances ?

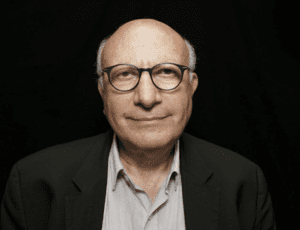

« L’intelligence artificielle est pour la communauté de la cybersécurité un outil de base, à sa disposition, et elle ne se prive pas pour s’en servir à l’occasion, mais c’est un outil parmi d’autres » assure Ludovic Mé, adjoint au directeur scientifique de l’Inria, en charge du domaine de recherche « Cybersécurité », et par ailleurs membre de l’équipe CIDRE (Confidentiality, Integrity, Disponibility, REpartition) de l’Irisa à Rennes.

La sécurité informatique est une problématique complexe, comportant de multiples facettes. Et l’IA n’est pas toujours la réponse idéale. « La sécurité préventive, par exemple, fait plutôt appel à d’autres spécialités informatiques, comme la cryptographie » indique-t-il. Qui plus est, il n’est pas toujours facile de réunir les compétences nécessaires pour avancer sur certains aspects particuliers. « Malheureusement, les communautés de l’IA et de la cybersécurité sont parmi les plus sollicitées qui soient » déplore le chercheur. C’est l’une des difficultés à surmonter.

Autre problème : le fer de lance de l’IA, l’apprentissage automatique, est avide de données. « La question de la quantité de données disponible est centrale » confirme Ludovic Mé. La quantité, mais aussi la qualité. « Constituer des bases de données de qualité est un enjeu majeur, précise-t-il. Où trouver ces données, comment les sélectionner ? Avoir accès à des bases de données conséquentes est l’une des conditions pour réaliser des outils efficaces reposant sur l’apprentissage automatique. Et c’est plus ou moins facile selon la spécialité. Il est particulièrement difficile, par exemple, de réunir des données concernant les attaques. »

PARTAGER LES DONNÉES DISPONIBLES

Comment faire ? « Ce n’est pas un hasard si le partage de données est l’un des principes fondateurs du Campus Cyber qui doit ouvrir à l’automne », indique Ludovic Mé. Aux dernières nouvelles, 112 entités, organismes ou entreprises, devraient le rejoindre à Puteaux. Des ténors et startups de la cybersécurité, mais également les ministères de l’Intérieur et des Armées, l’ANSSI (Agence nationale de la sécurité des systèmes d’information) et bien sûr l’Inria.

« Le machine learning peut surtout être utile en matière de sécurité réactive, explique-t-il. Pour détecter des menaces, et réagir. L’apprentissage automatique est intéressant pour détecter des anomalies. Il permet d’apprendre le fonctionnement normal d’un système, le trafic habituel sur un réseau… pour ensuite détecter des déviations par rapport à cette normalité. »

Un autre aspect de la cybersécurité est la recherche de vulnérabilités. « Analyser automatiquement du code afin de les détecter est un problème ardu, assure-t-il. On fonde des espoirs dans le recours à des approches à base de règles, ou hybrides, jouant à la fois sur l’IA symbolique et connexionniste. On travaille sur des outils destinés à assister l’homme dans les tests d’intrusion, en anglais penetration test ou pentest. »

DES ATTAQUES DE PLUS EN PLUS VARIÉES

Quid de la détection des codes malveillants ? « Pour classifier les codes en “malware” et “goodware”, indique Ludovic Mé, on fait très souvent appel au machine learning. Il y a une raison simple à cela : on dispose de beaucoup de données. Sur les virus, en particulier, il y a beaucoup de travaux. »

On dit souvent que l’intelligence artificielle est indispensable en cybersécurité parce que la vitesse de réaction est un aspect essentiel et que face à certaines attaques sophistiquées, l’homme ne peut pas prendre toutes les décisions efficaces assez vite. « C’est en partie vrai, estime le chercheur. On doit parfois faire face en effet à des attaques très rapides, explosives, face auxquelles il est nécessaire de répondre très vite, de manière automatique. » Mais l’intelligence artificielle n’est pas la seule bonne réponse.

« Et n’oublions pas, ajoute Ludovic Mé, qu’il existe par ailleurs un type d’agression particulièrement nocive, que l’on appelle APT, pour “Advanced Persistent Threat” (menace persistante avancée), qui repose au contraire sur la furtivité et le long terme. Ces attaques lentes, à faible bruit, sont particulièrement difficiles à détecter. » Encore une fois, l’IA peut jouer un rôle dans la lutte contre ce type d’agression, mais n’est pas une baguette magique.

Dans la période récente, le rançongiciel (ransomware) a fait plus d’une fois la Une des médias. Des entreprises et même des hôpitaux ont fait les frais de ces attaques particulièrement insidieuses reposant sur le chantage : « Payez la rançon, où nous détruisons vos données. » Se protéger contre les rançongiciels est particulièrement difficile. « Mais des solutions se font jour, assure Ludovic Mé. À Rennes, notamment, la startup Daspren s’appuie sur des travaux d’Inria pour développer un logiciel de protection contre ces rançongiciels faisant appel à l’apprentissage automatique. »

LES OBJETS CONNECTÉS, CES NOUVELLES CIBLES

L’aubaine pour les hackers malveillants est la multiplication presque exponentielle des cibles potentielles. Aux ordinateurs proprement dits s’ajoutent désormais d’innombrables objets connectés, qui peuplent l’Internet of Things (IoT), l’Internet des objets. Abdelkader Lahmadi, directeur scientifique du Laboratoire de haute sécurité (LHS) de Nancy, et membre de l’équipe RESIST (Resilience and Elasticity for Security and ScalabiliTy) au Loria (CNRS, Université de Lorraine, Inria) explique que « des outils de sécurisation spécifiques sont à l’étude, en particulier, SCUBA, une suite logicielle d’audit et de diagnostic de sécurité développée au sein de l’équipe RESIST, qui permet d’analyser automatiquement le risque des objets connectés. » Cet outil ausculte le comportement de l’objet connecté dans son environnement, ses échanges avec le monde extérieur, et constitue une base de connaissances décrivant ce comportement. Cela en faisant appel à des algorithmes d’apprentissage automatique pour prédire le risque associé à ce comportement. La start-up Cybai, en cours de création, devrait prochainement commercialiser SCUBA.

L’intelligence artificielle se rend déjà utile dans la lutte contre l’insécurité informatique et devrait à l’avenir y jouer un rôle majeur, au moins pour prendre en charge certains aspects de ce vaste domaine d’application. Mais cela en complémentarité avec d’autres approches également prometteuses. Sur ce terrain comme ailleurs, l’IA n’est pas une potion magique.