Du risque d’une superintelligence artificielle

Comme le rappelait récemment Nick Bostrom, philosophe et directeur du Future of Humanity Institute dans une conférence à l’USI (Unexpected Sources of Inspiration), « les pionniers de l’intelligence artificielle (IA) étaient très optimistes, ils pensaient que cela ne prendrait qu’une dizaine d’années. Mais malgré cela, ils ne s’exprimaient pas sur les conséquences … Il y a eu étonnamment peu de réflexion sur ce qui se passerait si nous parvenions vraiment à reproduire la forme d’intelligence générale qui caractérise l’esprit humain. » Son institut a rejoint en mai 2017 l’organisation créée en septembre 2016 par Google, Amazon, Facebook, IBM et Microsoft, Partnership on AI, destinée à promouvoir les bonnes pratiques. Rappelons que Nick Bostrom avait publié un essai remarqué en 2014 sur la superintelligence.

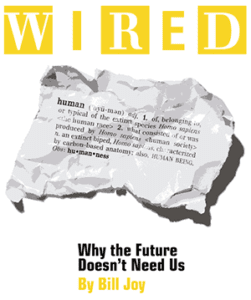

Les réflexions éthiques autour de l’IA sont désormais partagées par le plus grand nombre, chercheurs et industriels. Si certains comme Irvin John Good prévoyaient dès 1965 le risque d’une machine ultra intelligente, idée reprise en 1993 par Vernor Vinge, c’est surtout à partir du XXIe siècle que les risques liés à une superintelligence sont de plus en plus souvent évoqués, à l’instar de la publication de Bill Joy en 2000 et lors des débats qui ont suivi en 2004. Dès 2005, Raymond C. Kurzweil analyse les impacts de ce qu’on appelle la « singularité technologique ». C’est ce point hypothétique de l’évolution technologique au-delà duquel les changements seraient imprévisibles. C’est un des sujets d’étude du Center for Study of Existential Risk créé en 2012. De nombreuses personnalités comme Stephen Hawking, Elon Musk ou Bill Gates prennent désormais régulièrement part au débat pour alerter l’opinion publique comme en 2015, dans une lettre ouverte. Ainsi, le 15 juillet dernier, devant les gouverneurs des Etats américains, Elon Musk réitérait ses mises en garde contre ce qu’il qualifie de « plus grand danger pour la civilisation humaine » et appelait à mettre en place une régulation avant qu’il ne soit trop tard.

Isabelle Bellin

De quoi poursuivre la réflexion :

- Superintelligence: Paths, Dangers, Strategies de Nick Bostrom, 2014

- Le Mythe de la Singularité, Faut-il craindre l’intelligence artificielle ? de Jean-Gabriel Ganascia, 2017