Pour la voiture totalement autonome, les chercheurs demandent… un petit délai ;-)

⏱ 7 minC’est un phénomène classique dans la sphère IA : la « hype ». Le Larousse propose comme traduction : “battage publicitaire”, “publicité monstre” ou encore “bla-bla”. La voiture autonome en a été victime, mais nous avons passé la crête de la vague. Alors, où en est-on ?

La voiture qui conduit toute seule, Elon Musk, le patron de Tesla, la promet pour l’année prochaine… depuis 2014. Timide, cette année-là, il évoque une conduite automatique seulement 90% du temps. Depuis, il s’est enhardi, annonçant en 2019 l’arrivée de « robotaxis » et, toujours pour l’année prochaine, la possibilité de s’endormir au volant. Coup de théâtre en juillet 2021 : le même Elon Musk a une révélation, et semble découvrir, dans un tweet que : « La conduite complétement autonome est un problème difficile, car elle nécessite de résoudre une grande partie de l’IA du monde réel. Je ne m’attendais pas à ce que ce soit si difficile, mais la difficulté est évidente rétrospectivement. »

Cette « évidente difficulté » que tout le monde n’avait visiblement pas vraiment anticipée, a d’ailleurs poussé certains acteurs de poids à jeter l’éponge. Après Uber, qui a vendu en 2020 son unité dédiée au taxi sans pilote à Aurora Innovation, une start-up fondée par un ancien de Google (aujourd’hui cotée en bourse et évaluée à 3 milliards de $), son concurrent Lyft a cédé l’an dernier à Toyota sa division consacrée à la voiture autonome.

Aux USA, Tesla fait appel à des clients cobayes

Mais Elon Musk est pressé. Des versions “bêta” successives du mode de conduite “Full Self-Driving” (mot à mot : auto-conduite complète) des Tesla sont testées aux États-Unis et au Canada par de valeureux propriétaires cobayes, qui paient 12 000 dollars pour ce privilège. Ce qui permet à la firme d’engranger de précieuses données issues de ces véhicules, et notamment des enregistrements de situations critiques, des incidents entrainant parfois des accidents. Lesquels font d’ailleurs l’objet de vidéos peu flatteuses, publiées via Twitter. On peut ainsi voir une Tesla griller un feu rouge, la priorité aux piétons et chercher à rouler sur des rails, ou une autre forçant son conducteur à faire une embardée, qui provoque une sortie de route, pour éviter une collision frontale. Chroniquement, ces braves testeurs bénévoles luttent au volant contre le pilotage automatique. A contrario, ce Full Self-Driving se montre parfois si prudent en ville, en présence de nombreux piétons sur les trottoirs, qu’il inflige des coups de frein intempestifs.

Certains clients de Tesla commencent à râler, et à réagir. Depuis le 14 septembre, le constructeur fait l’objet d’une « class action » (recours collectif) auprès du tribunal fédéral de San Francisco accusant la société d’Elon Musk d’avoir induit le public en erreur en annonçant à tort ses fonctionnalités « Autopilot » et surtout « Full Self-Driving ». Selon l’agence Reuters, « La plainte accuse Tesla d’avoir, depuis 2016, annoncé de manière trompeuse la technologie comme étant pleinement fonctionnelle ou « juste au coin de la rue » alors qu’ils savaient que la technologie ne fonctionnait pas ou était inexistante et rendait les véhicules dangereux. » Toujours selon Reuters, le plaignant aurait déclaré : « Tesla n’a encore rien produit qui s’approche de loin d’une voiture entièrement autonome. » Il aurait ajouté que les clients de Tesla qui reçoivent des mises à jour logicielles « agissent effectivement comme des ingénieurs de test non formés » et ont trouvé « une myriade de problèmes ».

Précédemment, en juillet dernier, le département californien des véhicules à moteur avait déjà accusé Tesla d’avoir exagéré les performances de ses systèmes d’assistance à la conduite. Il faut dire que depuis 2016, la National Highway Traffic Safety Administration a enquêté sur 38 accidents impliquant des Tesla roulant sur autoroute en pilotage automatique. Ils ont provoqué dix-neuf décès.

…et on teste des voitures sans pilote ici et là

Pourtant, toujours aux États-Unis, où la notion d’homologation des véhicules n’existe pas, certains états autorisent même d’ores et déjà des entreprises, au cas par cas et dans certaines limites, à tester des véhicules offrant la conduite autonome intégrale, sans conducteur (niveau 5). En Californie, notamment, des autorisations ont été accordées à des entreprises comme Waymo (filiale d’Alphabet), Nuro (une start-up californienne), AutoX (une start-up chinoise) et Zoox (start-up rachetée par Amazon en juin 2020), avec certes des restrictions en termes de périmètre, de vitesse et de météo. En Arizona, c’est Waymo qui propose depuis octobre 2020 un service de taxis sans chauffeur, dans une zone à l’est de Phoenix, la East Valley. Mais ces expériences ne vont pas sans retours de bâton. Ainsi, en juin dernier, la firme Cruise, filiale de General Motors, a dû « rappeler » 80 véhicules équipés pour la conduite sans conducteur, après un accident à San Francisco ayant blessé deux personnes.

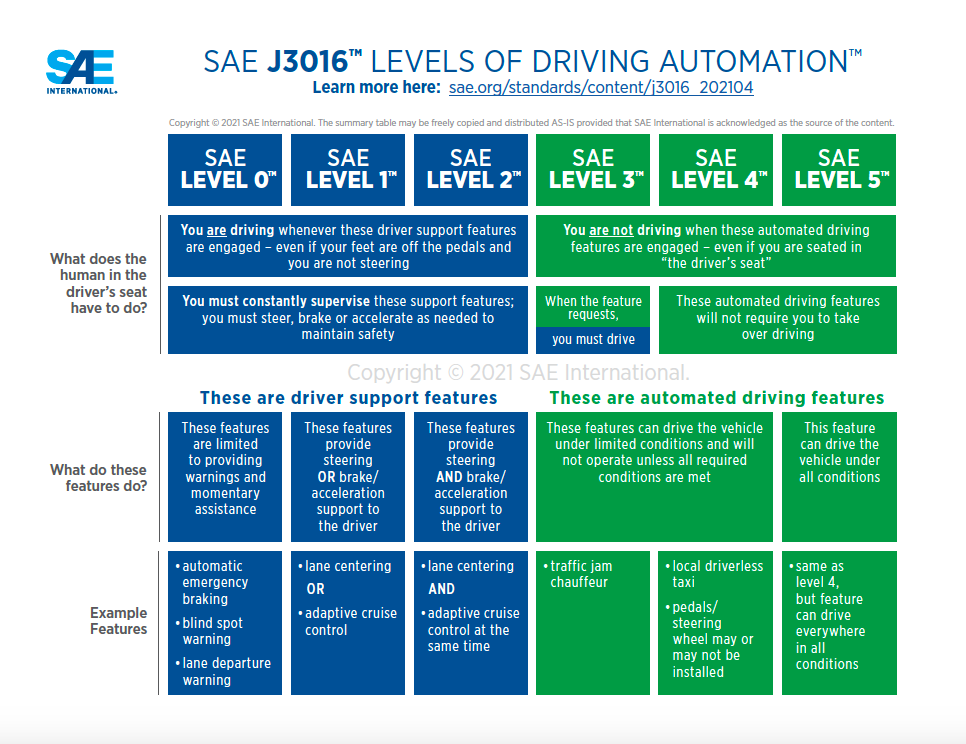

Par contraste, on est loin en Europe d’envisager l’arrivée prochaine de la conduite 100% autonome, et on adopte une approche beaucoup plus prudente. Seule la conduite autonome de niveau 3 est à l’ordre du jour. Elle est autorisée depuis le 14 juillet au sein de l’Union européenne. La France a interprété cette directive dans ses textes, et depuis le premier septembre, la conduite semi-autonome de niveau 3 y est donc autorisée. Traduction : il s’agit de conduire momentanément « sans les mains ». Le conducteur doit pouvoir à tout moment reprendre le contrôle du véhicule et intervenir en moins de dix secondes. Et cela seulement dans des circonstances précises. Tout d’abord, cette possibilité n’est ouverte que sur des tronçons de route interdits aux piétons et aux cyclistes, et dotés d’un séparateur central. Secundo, elle n’est autorisée que dans la limite d’une vitesse inférieure à 60 km/h. Pas question., donc d’y faire appel sur autoroute… sauf dans les bouchons.

Précision importante : en cas d’accident, la conduite autonome de niveau 3 enclenchée, le conducteur ne sera pas tenu responsable. Selon la législation française, c’est le constructeur qui est responsable pénalement. Mais au fait, pour profiter de cet aménagement de la réglementation… il faut être en possession d’un véhicule offrant ce fameux niveau 3. Or, il semble qu’à l’heure actuelle, un seul constructeur, Mercedes, soit en mesure de proposer un système de conduite automatisée de niveau 3 certifié. Son Drive Pilot est disponible en option sur les Classe S et EQS… en Allemagne, pour le moment.

Les cinq niveaux d’automatisation de la conduite selon SAE International (Society of Automotive Engineers), une organisation professionnelle internationale très active et écoutée en matière de normalisation dans le secteur automobile. © SAE International

De nombreux problèmes, et pas seulement techniques

La liste des problèmes à régler avant de pouvoir autoriser la conduite totalement autonome est fort longue. Au-delà de la difficulté technique, il faut citer les questions relevant du juridique, de l’assurance, de la standardisation, de la certification, de l’acceptabilité par le public, de la qualité des infrastructures… Qui est responsable en cas d’accident mettant en cause un véhicule totalement autonome ? Comment les assurances vont-elles prendre en charge ce type d’accident ? Qui vérifiera que les bases de données utilisées pour l’apprentissage des intelligences artificielles sont suffisantes et n’induisent pas des biais ? Et surtout, le code de la route doit-il lui aussi évoluer pour s’adapter à l’arrivée des véhicules autonomes ? « La question n’est pas seulement de savoir quand ces technologies arriveront, mais également si nous serons prêts à les accueillir et en mesure de les utiliser de la meilleure façon possible », explique Anne Spalanzani, maître de conférences à l’université de Grenoble Alpes et responsable permanent de l’équipe Chroma de l’Inria.

Restent les questions techniques, qui sont nombreuses. Sur le plan matériel, par exemple, les capteurs actuellement disponibles à un prix non rédhibitoire n’offrent pas les mêmes performances que les meilleurs produits dont cette industrie est capable, mais à un prix prohibitif pour l’industrie automobile. Côté logiciel, on demande en substance à l’intelligence artificielle de faire… des miracles. « Les problèmes à résoudre sont nombreux, explique Anne Spalanzani. Il faut notamment grandement améliorer la robustesse de tous les algorithmes impliqués dans ces systèmes. Robustesse par rapport à toutes sortes de circonstances. Robustesse aux pannes, pour commencer. Par exemple des capteurs. Que fait-on quand une caméra est soudainement occultée par une projection de boue ? Que fait-on si les informations fournies par les caméras et le lidar sont contradictoires ? »

Et ce n’est pas tout, estime la chercheuse : « Il faut encore que ces algorithmes soient robustes vis-à-vis des conditions météo. » On aimerait qu’ils perçoivent correctement l’environnement et prennent les bonnes décisions en cas de brouillard, de pluie, de neige ou de grêle. Et même plus simplement de nuit ou lorsque le soleil est en face. « Problème de robustesse encore, lorsque la signalisation est défaillante, poursuit Anne Spalanzani. » On sait que des algorithmes de vision reposant sur l’apprentissage profond se sont révélés incapables de reconnaître des panneaux défigurés par un simple autocollant. Quel algorithme saura nous tirer d’affaire sur ces sections d’autoroute, par exemple, ou une signalisation horizontale toute fraîche contredit l’ancienne, encore visible ? Pour atteindre le niveau 5, les systèmes de conduite autonome devront être capables de fonctionner correctement dans toutes sortes de conditions dégradées, et la liste est longue. La malveillance, par exemple devra être prise en compte. La protection contre le piratage est un thème de recherche…

En ville, ça se complique

Signe des temps, le site web de l’Inria publiait en juillet dernier un article titré : « Les véhicules autonomes sont-ils vraiment pour demain ? » Un point d’interrogation annonçant un texte qui met les points sur les « i ». Anne Spalanzani, notamment, y intervenait. « Aujourd’hui, les véhicules autonomes savent faire des choses dans des environnements simples, mais dès qu’ils arrivent dans un environnement urbain, cela devient trop compliqué pour eux, expliquait la chercheuse. Les capteurs actuels, associés à leurs algorithmes de traitement de données, n’ont pas la capacité de percevoir l’environnement comme l’humain le fait. »

Et parmi les choses qu’il faut résolument bien percevoir, il y a ce gêneur : le piéton. Anne Spalanzani est une spécialiste de la navigation dans les environnements où les véhicules côtoient des humains. « La relation véhicule-piéton est un problème très délicat, affirme la chercheuse. Nous, les humains, savons interpréter des signaux très subtils. Nous savons distinguer le piéton qui nous a vu de celui qui ne nous a pas encore vu. Et interpréter les signes d’un piéton. Et même son regard. C’est ce que l’on appelle la communication des intentions. » Anne Spalanzani travaille notamment sur la prédiction des trajectoires des piétons : « Un véhicule autonome doit par exemple être capable de prédire si et quand il pourra passer derrière un piéton qui est en train de traverser. » Mais il n’y a pas que les piétons qui posent de grandes difficultés. Il y a encore les cyclistes. « Et n’oublions pas les trottinettes », ajoute la chercheuse. Et les rollers, skateboards, gyropodes…

Dans ce même article publié par l’Inria, s’exprimait également Fawzi Nashashibi, le responsable de l’équipe-projet RITS du centre Inria de Paris. S’ils sont bardés de capteurs et d’IA, y expliquait le chercheur, il manque aux véhicules offrant aujourd’hui des capacités de conduite semi-autonome un élément essentiel pour aller plus loin : des capacités de communication, avec l’infrastructure routière et les autres véhicules. Elles permettraient aux voitures de coopérer les unes avec les autres ou de dialoguer avec les infrastructures, pour anticiper de potentiels dangers, mais aussi pour consolider leur perception de l’environnement. « Le sujet a été polémique pendant très longtemps, précisait le chercheur. Beaucoup d’acteurs du secteur ne concevaient les véhicules autonomes que par leur propre autonomie. […] Aujourd’hui, on commence à se rendre compte qu’il faut équiper les véhicules de moyens de communication, mais on ne sait pas qui doit le faire, les constructeurs ou les opérateurs, et quel modèle de communication va devenir la norme […]. »

Nous sommes prévenus. Les constructeurs nous proposerons dans les années à venir des voitures toujours un peu plus autonomes, mais qui supposeront un conducteur toujours en alerte. Pour la voiture totalement autonome, capable d’emprunter n’importe quel type de trajet sans pilotage humain, il faudra encore attendre quelque temps. Pour mettre au point l’intelligence artificielle capable d’un tel miracle, les chercheurs demandent… un petit délai.

Pierre Vandeginste

Pour en savoir plus…

Notre dossier de février 2020 consacré à la perception des véhicules autonomes.