La voiture autonome doit aussi avoir l’œil sur son conducteur

⏱ 4 minTant qu’elle ne sera pas totalement autonome, la voiture du futur comportera un volant, des pédales… et nécessitera un conducteur toujours prêt à prendre le relais. C’est pourquoi elle devra en permanence être capable de le surveiller.

Pour devenir plus autonome, le véhicule du futur devra mieux percevoir la route… mais aussi le conducteur. « Il est important d’évaluer la vigilance du conducteur, et donc sa capacité à reprendre la conduite manuelle lorsque les circonstances l’exigent, confirme Jean-Louis Vercher, directeur de recherche à l’Institut des Sciences du mouvement Étienne-Jules Marey (Aix-Marseille Université) et chargé de mission « Cognition » au CNRS. L’Europe va imposer que les véhicules proposant une autonomie de niveau 3 soient dotés d’un dispositif de monitoring du conducteur. Lorsque le conducteur, enclenchera par exemple sur autoroute, ce niveau 3, souvent défini par la formule “eyes off-hands off” (voir l’article 1 de ce dossier « Sur les voitures autonomes, des capteurs multiples, divers et complémentaire« ), il sera supposé rester “mind on”, et donc capable de reprendre le contrôle en une dizaine de secondes. Il pourra lâcher le volant, ne pas surveiller la route en permanence, mais il ne devra pas s’endormir. Il devra rester dans la boucle… »

Comment contrôler la vigilance ?

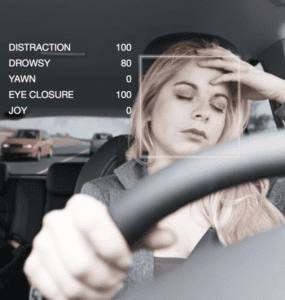

Pour commencer, comment s’assurer que le conducteur n’est pas assoupi ? « La source d’information la plus fiable dans ce domaine est l’électroencéphalogramme, affirme Pierre Philip, directeur du laboratoire Sanpsy (sommeil, addiction, neuropsychiatrie) de l’université de Bordeaux. On l’utilise depuis longtemps dans l’aviation. Certains casques destinés aux pilotes de chasse comportent des électrodes. Nous avons montré que c’était également très efficace dans le contexte de l’automobile. » Mais exiger que les conducteurs de véhicules autonomes portent un casque ou un bonnet doté d’électrodes n’est pas très réaliste. « L’appuie-tête muni d’électrodes a été étudié, poursuit Pierre Philip. C’est une solution… tant que le conducteur y appuie sa tête. C’est pourquoi on s’intéresse à des solutions moins intrusives, moins contraignantes. Nous travaillons sur des algorithmes de vision artificielle qui savent détecter les yeux et leur occlusion. D’autres permettent de suivre les mouvements de la tête et notamment sa chute, qui signale l’assoupissement. »

© Affectiva

Mais mesurer le niveau de vigilance n’est pas chose facile. « On ne peut pas se fier aux apparences, remarque Jean-Louis Vercher. On sait aujourd’hui que certaines personnes peuvent avoir l’air assoupies alors qu’elles sont alertes, et inversement. » Les dispositifs doivent établir leur diagnostic en se basant sur plusieurs critères, voire en multipliant les sources d’information : « En plus des caméras, ajoute Jean-Louis Vercher, la mesure de la résistance électrodermale, grâce à des électrodes disposées sur le volant, est intéressante. Certaines équipes travaillent, quant à elles, sur la détection du rythme cardiaque – qui renseigne sur le stress, l’état émotionnel – à l’aide d’électrodes sur le volant ou de capteurs dans le dossier. Il faut garder à l’esprit que le niveau de vigilance du conducteur n’est pas qu’une question de somnolence. Une conversation téléphonique, même via un dispositif “mains libres”, peut être très immersive et emporter le conducteur très loin de la route. C’est pourquoi tout ce qui renseigne sur son activité peut s’avérer utile pour décider de sa capacité à reprendre la main. »

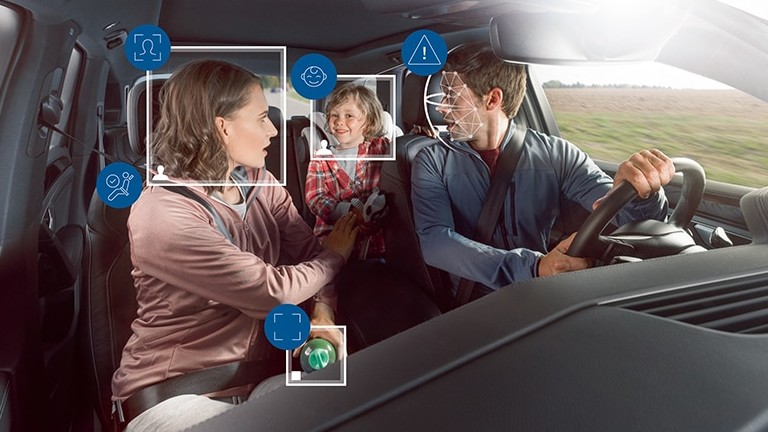

© Bosch

Grands équipementiers et start-up sont dans la course

Un copieux marché de la perception dans le véhicule se profile donc à l’horizon. Les grands équipementiers sont déjà dans la course. Ainsi, chez Continental Automotive France, à Toulouse, Alain Giralt, expert en systèmes de vision, indique : « Nous avons commercialisé, en 2017, un premier dispositif de surveillance du conducteur (« driver monitoring »), reposant sur une caméra équipée d’éclairage dans le proche infrarouge, placée derrière le volant sur la colonne de direction, et des algorithmes d’apprentissage automatique. Il mesure essentiellement l’ouverture des yeux, la durée des clignements et les mouvements de la tête, et délivre une évaluation du niveau de vigilance. » Au constructeur de décider ce qu’il en fera : alerte visuelle, sonore, vibration du siège ou du volant, voire freinage d’urgence. « Nous finalisons une seconde génération, améliorée, qui analyse également la bouche (bâillement, parole…) et détecte mieux l’orientation du regard, ajoute Alain Giralt. Par ailleurs nous développons un prototype qui surveille tout l’habitacle (« in-cabin monitoring »), via une caméra grand angle située sur le rétroviseur central. Il voit le conducteur entier (tête, buste, mains…) et repère les passagers. Il détecte divers comportements : le conducteur n’a pas les mains sur le volant, il ne regarde pas la route, ni le tableau de bord, mais sa main, il règle le GPS, fouille dans la boîte à gants, se retourne vers un passager…”

Le marché à venir du « driver monitoring » et du « in-cabin monitoring » a déjà suscité la création de dizaines de start-up. La plupart proposent des solutions reposant sur une approche optique (caméra, parfois 3D infrarouge avec illumination, faisant appel à la lumière structurée ou à la mesure du temps de vol). Elles sont nombreuses aux États-Unis (Eyeris Technologies, Edge3, Trilumina, Affectiva, Sighthound) et en Israël (Guardian Optical Technologies, Jungo Connectivity, Eyesight Technologies, Viisights), on en trouve également en Australie (Seeing Machines, Optalert) ou encore en Suède (Smart Eye). Les solutions reposant sur un radar miniaturisé, qui permettent entre autres la détection à distance d’un pouls ou d’une respiration, semblent être une spécialité israélienne (Vayyar, Caaresys, Neteera). Au-delà de la vigilance du conducteur, certaines start-up proposent toutes sortes d’informations complémentaires. Comme l’identification du chauffeur, ses émotions, le comptage des passagers, leur identification, la présence d’enfants… Et jusqu’à l’oubli d’un bébé dans une voiture fermée. Un vaste choix de solutions s’offre aux constructeurs pour que la voiture du futur soit attentive à la vigilance de son conducteur et au bien-être de ses passagers.

Pierre Vandeginste

Illustration à la une : © Eyesight Technologies