Voiture autonome : un déluge de données à interpréter

Avec sa multitude de capteurs embarqués, la voiture autonome générera bien plus de données que tous les autres véhicules déployés avant elle. Pour faire face à cette situation inédite, la puissance de calcul disponible à bord sera la clé.

La réalité est en passe de rattraper la fiction. D’ici à 2025, les premières voitures autonomes, capables de se déplacer sans l’intervention d’un conducteur grâce à leur intelligence artificielle, pourraient bien faire leur apparition sur nos routes. Mais cette révolution technologique s’accompagnera d’une autre, en termes de volume de données produites. On estime en effet que chaque véhicule sans pilote générera à lui seul plus d’un gigaoctet (Go) de données par seconde ! En comparaison, un avion de ligne produit environ 15 Go de données mais sur la totalité du vol. Une situation totalement inédite donc pour des véhicules déployés à grande échelle et à laquelle il faudra faire face intelligemment.

Pourquoi un tel déluge de données ? C’est que pour pouvoir circuler par elle-même, une voiture autonome doit d’abord percevoir à chaque instant son environnement, avec tout ce qui le compose (marquage au sol, panneaux, autres véhicules, piétons, etc.). Pour cela, on l’a dotée d’une multitude de capteurs. Ainsi, les voitures prototypes, qui sont actuellement en phase de test et qui sillonnent déjà les routes un peu partout dans le monde, embarquent avec elles quatre types de détecteurs différents : des caméras, qui sont les yeux de la voiture, des lidars, qui recréent une image en trois dimensions des objets environnants grâce à leurs lasers, des radars, particulièrement adaptés pour déterminer la distance avec les autres véhicules à partir d’ondes radio, et des sonars, chargés de la détection des objets proches grâce à des ultrasons.

Une perception fine de son environnement

« Les informations données par tous ces capteurs se complètent de façon à ce que la voiture puisse »voir » en permanence, quels que soient les conditions météo, le type d’objet à détecter, ou à quelle distance », explique Arnaud de La Fortelle, directeur du centre de robotique de MINES ParisTech. Par exemple, dans le brouillard, la caméra devient aveugle, mais le lidar – parce qu’il émet de la lumière dans l’infrarouge – et le radar continuent à percevoir l’environnement. Pour les panneaux de signalisation, si le lidar est capable de les détecter, seule la caméra peut les déchiffrer. Quant aux piétons et aux voitures, seuls le lidar et le radar peuvent fournir une mesure précise de leur distance, la caméra ne pouvant que l’estimer. Et pour le marquage au sol, la caméra, tout comme le lidar, peuvent le repérer et permettre ainsi à la voiture de rester dans sa voie.

Premier responsable de ce déluge de données : les caméras. À elles seules, elles produisent aujourd’hui la quasi totalité des données brutes. Et la tendance n’est pas prête de s’infléchir. Déjà, des caméras dites 4K, dotées d’une meilleure résolution que les générations précédentes pour voir des objets plus petits et plus loin, sont testées sur les véhicules prototypes. Le calcul est simple : avec une résolution s’approchant de 10 mégapixels sur chaque image et avec une fréquence pouvant atteindre 100 images par seconde, ces caméras généreront plus de 1 Go de données brutes par seconde… Sans compter que, pour voir dans toutes les directions, on multiplie les caméras sur les voitures sans pilote. Celles développées par les entreprises américaines Uber et Tesla par exemple en comptent respectivement sept et huit.

Quant aux lidars et aux radars, même si leur impact dans cet afflux de données est moindre, ils ne sont pas en reste. Un lidar collecte ainsi près d’un million de points de mesure par seconde. Et tout comme les caméras, les lidars de nouvelle génération seront plus précis encore, en augmentant le nombre de lasers qu’ils contiennent. Les progrès accomplis sont déjà énormes : s’il y a quelques années encore, les lidars étaient composés d’un seul laser, ils peuvent aujourd’hui en contenir jusqu’à 64, comme celui développé par l’entreprise américaine Velodyne, qui équipe notamment les voitures autonomes de Google et leur permettent de scanner leur environnement à 360°.

Autant de données à traiter dans chaque véhicule

Comment fera-t-on face à cette avalanche de données ? Pour Arnaud de La Fortelle, il n’y aura pas le choix. « Vu la quantité de données, leur traitement ne pourra se faire que localement, à l’intérieur de la voiture. En effet, l’idée de traiter les données de façon partagée, entre véhicules autonomes connectés par exemple, serait impossible à mettre en œuvre, le flux de données à transmettre dépassant largement les débits actuels ». Bref, la voiture autonome ne pourra compter que sur son intelligence artificielle embarquée pour analyser en temps réel les données en provenance de tous les capteurs, leur donner un sens et de là, décider d’une manœuvre à exécuter.

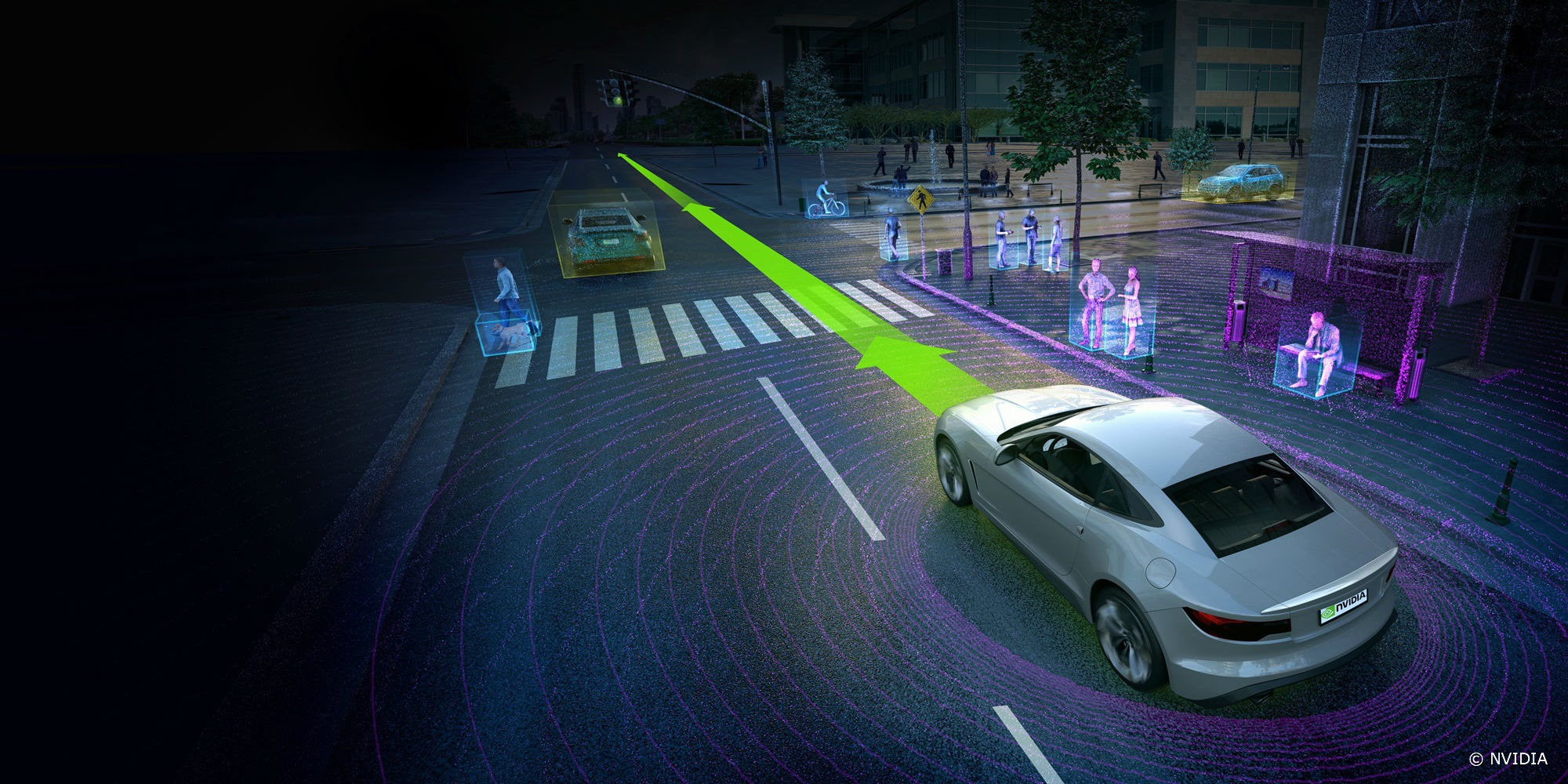

Pour remplir cet objectif, outre les algorithmes qui devront être extrêmement performants (lire l’article 2 : « Comment la voiture autonome apprend à conduire, pas à pas… »), la puissance de calcul devra donc être au rendez-vous. Et dans cet exercice, un type particulier de microprocesseurs est en train de tirer son épingle du jeu : les GPU (Graphics Processing Unit). Développés initialement pour l’affichage de nos ordinateurs, ils sont aujourd’hui utilisés dans les supercalculateurs et on les retrouve de plus en plus au sein des véhicules autonomes. Leur force ? « Dotés d’un très grand nombre de cœurs de calcul, ils sont capables d’exécuter en parallèle un nombre très élevé d’opérations. C’est cette caractéristique qui les rend particulièrement adaptés à la voiture autonome, car il s’agit d’analyser très rapidement une multitude de données provenant à la fois de différents capteurs et de différents points de l’espace », précise Olivier Charra, à la tête de l’équipe software solution architect de Nvidia.

L’entreprise américaine entend jouer un rôle de premier plan dans le développement de la voiture autonome. Récemment, elle a mis au point un processeur composé de GPU, baptisé Xavier, et déjà déployé sur des véhicules de test. « En combinant plusieurs de ces processeurs, nous augmentons la puissance de calcul et nous allons ainsi être capables dans les années qui viennent d’équiper des véhicules aux niveaux d’automatisation de plus en plus élevés, avant le niveau 5, c’est-à-dire l’automatisation totale (lire encadré En route vers l’autonomie). Quant à ce fameux niveau 5, nous avons d’ores et déjà développé en laboratoire un ordinateur dont la puissance de calcul est suffisament élevée pour faire face à la quantité de données qu’il sera nécessaire de traiter pour l’atteindre », se réjouit Olivier Charra.